“보안수칙 동의서 등 유명무실…공공기관 모델 필요”

서울시 공무원의 행정 효율을 높이기 위해 도입한 ‘서울AI(인공지능)챗’에서 개인정보 유출 위험성이 있는 것으로 나타났다. 인터넷망 기반인 서울AI챗은 챗GPT 등 외부 시스템을 빌려와 운용되고 있다. 일부 직원이 개별 입력 시 민원 상담 등 개인정보가 유출될 수 있어 보완이 필요하다는 지적이 나온다.

21일 국회 행정안전위원회 소속 더불어민주당 위성곤 의원이 서울시로부터 제출받은 자료에 따르면 서울시가 지난 9월 시범 도입한 서울AI챗은 폐쇄망이 아닌 외부 인터넷망을 통해 응용 프로그램 인터페이스(API, Application Programming Interface)와 연계해 사용된다. API는 서로 다른 소프트웨어가 정보를 주고받을 수 있도록 ‘중간다리’ 역할을 한다. API를 활용해 서울시 시스템과 외부 AI가 데이터 등을 주고받는 구조다. 직원이 입력하는 모든 정보가 서울시 내부망이 아닌 외부 사업자 서버로 전송되는 셈이다.

서울AI챗은 챗GPT, 제미나이 등을 포함한 29가지 생성형 AI를 공무원이 업무 특성에 맞게 사용해 직원 편의와 행정 효율을 높일 수 있도록 서울시에서 지원하는 서비스다. 서울시는 지난해부터 생성형 AI를 시범 적용할 직원을 600명가량 모집해 신기술 이용료(구독제)를 지원한 바 있다. 신청자가 몰리자 서울시는 개별 직원의 구독 지원을 넘어 사용량에 따라 비용을 지불하는 생성형 AI 용량제인 ‘서울AI챗’을 도입해 올해 12월까지 시범 활용할 예정이다.

앞서 서울시는 구독제에 참여한 직원들이 주로 아이디어 도출, 자료 조사와 문서 작성 등에 AI를 이용했다고 밝혔으나, 사업비 내역이나 계약 문서, 민원 내용 등 민감한 내부 문서도 입력이 가능한 실정이다. 통상 민감한 데이터를 다루는 해외 국가나 공공기관에서는 인터넷망과 폐쇄망을 분리 운영한다. 인터넷을 통한 불법적인 접근이나 정보 유출 등 외부 위협을 원천 차단하기 위해서다.

서울AI챗 도입에 앞서 서울시는 이를 사용하는 전 직원들에게 정보 보안을 다짐하는 서약서 제출을 요청했다. 해당 서약서에는 민감정보 입력 금지, 생성물 검증·출처 표기, 비윤리적 활용 금지 등의 내용이 담겼다. 디지털 권한 관리(DRM, Digital Rights Management)가 적용된 내부 보안문서도 서울AI챗에 입력이 불가능하다고 고지했다. 그러나 직원 개인이 업무 효율을 위해 복사·붙여넣기 등 수동 입력 시 개인정보가 고스란히 유출될 수 있다는 지적이 나온다.

이와 관련해 이상근 고려대학교 정보보호대학원 교수는 “DRM 문서가 개인정보 유출에 있어서 보안이 된다고 생각하는 게 일차적인 문제”라며 “DRM 문서는 출력이나 캡처가 안 되더라도 생성형 AI에 사람이 직접 입력할 수 있는 가능성이 있다”고 지적했다.

이 교수는 “보안 수칙 서명 역시 개인의 판단에 기대는 것뿐 어떤 효력도 없다”며 “문서 별로 보안 등급을 나누는 등 정확한 체계에 의해서 관리하고 생성형 AI를 활용해야 한다”고 강조했다.

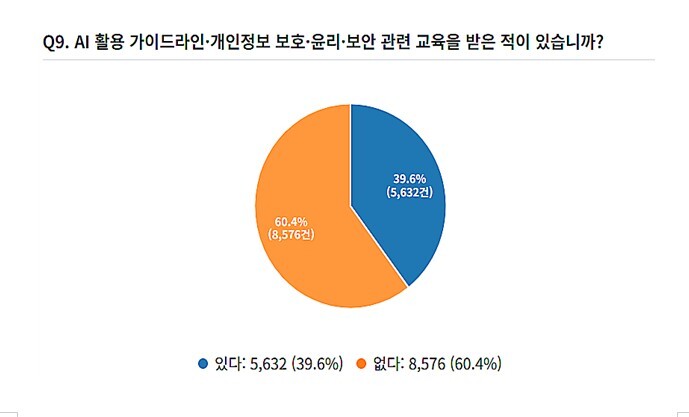

서울시뿐 아니라 다른 지자체 공무원들도 업무 시 AI를 적극 활용하고 있지만 보안·윤리적 기반은 취약한 것으로 드러났다. 위 의원실이 전국 행정기관(중앙부처·광역·기초자치단체) 종사자 1만4208명을 대상으로 지난달 17일부터 이달 6일까지 진행한 설문조사 결과에 따르면 응답자의 68.9%가 이미 생성형 AI를 업무에 활용한 경험이 있다고 답했다. 하지만 60.4%는 AI 활용 개인정보 보호·윤리·보안 등과 관련된 가이드라인 교육을 전혀 받은 적이 없다고 답했다.

위 의원은 “행정문서, 회의록 등 대외비를 비롯해 민원 상담파일, 녹취록 등 개인 정보가 인터넷망을 통해 처리돼 심각한 보안 취약성을 드러내고 있다”며 “행정 전용 폐쇄망을 기반으로 보안을 강화해야 한다. 지자체 별로 생성형 AI를 쓰는 게 아니라 공공기관 통합 모델이 필요하다”고 말했다.

이 같은 지적에 서울시 관계자는 “직원의 개인 일탈까지 100% 기술적으로 막을 수는 없지만 DRM 적용 문서는 사고가 발생했을 때 사후 안전장치로서 대화 내용 등을 추적이 가능하도록 기록된다”고 설명했다.

이어 “올해 말을 목표로 내부 전용 LLM 구축을 추진 중”이라며 “장기적으로는 ‘서울형 폐쇄망 AI 행정환경’으로 발전시킬 것”이라고 덧붙였다.

Copyright ⓒ 세계일보. 무단 전재 및 재배포 금지

![[설왕설래] 일본 차의 잇따른 脫한국](http://img.segye.com/content/image/2026/04/30/128/20260430521009.jpg

)

![[기자가만난세상] 한·미동맹 ‘정원’ 국익 중심 재설계를](http://img.segye.com/content/image/2026/03/30/128/20260330519236.jpg

)

![[삶과문화] 시인을 사랑해도 될까](http://img.segye.com/content/image/2026/02/19/128/20260219518190.jpg

)

![[박일호의미술여행] 새로움을 향한 고뇌의 얼굴](http://img.segye.com/content/image/2026/04/30/128/20260430520922.jpg

)

![[포토] 김태리 '완벽한 미모'](http://img.segye.com/content/image/2026/04/29/300/20260429509497.jpg

)